Het begrip Large Language Models klinkt misschien ingewikkeld, maar in deze blog leggen we in duidelijke taal uit wat ze zijn en hoe ze werken. Je leest hoe modellen met behulp van transformers en trainingsdata woordpatronen leren en hoe dat leidt tot natuurlijke tekst. Verder laten we praktische toepassingen zien voor MKB’ers, zoals chatbots, automatische klantenservice en contentgeneratie voor SEO.

We bespreken ook belangrijke aandachtspunten zoals bias, kosten en betrouwbaarheid, zodat je weloverwogen beslissingen kunt nemen. Tot slot geven we een stapsgewijze aanpak en een korte checklist om klein te beginnen met AI binnen jouw bedrijf. Lees verder voor concrete voorbeelden en concrete stappen die je morgen al kunt zetten.

Wat zijn Large Language Models?

Large Language Models zijn geavanceerde AI-systemen die menselijke taal begrijpen en genereren.

Een LLM (of groot taalmodel) leert patronen in enorme hoeveelheden tekst. Het kijkt naar woorden, zinnen en context en voorspelt het meest waarschijnlijke volgende woord. Hierdoor kan het coherente teksten schrijven, vragen beantwoorden en samenvatten. In eenvoudige woorden: een LLM is een statistische motor voor taal, maar dan opgeschaald naar miljarden parameters.

Waarom de term “large” belangrijk is

Grootte bepaalt vaak de reikwijdte en nuance. Grotere modellen hebben meer parameters en kunnen complexere verbanden leggen. Let op: groter is niet altijd automatisch beter voor elk doel; efficiency en datakwaliteit tellen ook zwaar mee.

Voorbeelden van bekende modellen

- GPT (OpenAI) – veel gebruikt voor tekstgeneratie.

- Gemini (Google) – sterk voor begrijptaken en classificatie.

- Llama 2, Claude en andere open-weight alternatieven.

Praktische tip

Als je snel wilt testen wat een LLM kan, begin met een gratis abonnement op bijvoorbeeld ChatGPT of Gemini API. Bij Ever Evolve merken we dat dit de makkelijkste manier is om de eerste mogelijkheden met een LLM te ontdekken zonder investeringen te doen.

Hoe werken Large Language Models technisch?

Kort samengevat: LLMs gebruiken transformers en zelf-attentie om context te wegen en tekst te voorspellen.

In de kern draait het om drie stappen: tokenisatie, embedding en attention. Tokenisatie splitst tekst in kleinere onderdelen. Daarna worden tokens omgezet naar getallen (embeddings). Zelf-attentie bepaalt welke woorden in de context belangrijk zijn voor de voorspelling. Dit proces herhaalt zich in lagen en leidt uiteindelijk tot een output-token dat het model genereert.

Zelf-attentie in één zin

Zelf-attentie vraagt voor elk woord: hoeveel moeten de andere woorden aandacht krijgen? Dat maakt langeafstandsinformatie en nuances mogelijk.

Pre-training en fine-tuning uitgelegd

Pre-training: het model leert algemene taalregels op gigantische datasets. Fine-tuning: het model wordt aangepast aan specifieke taken met kleinere, gelabelde datasets. Zo maak je een algemeen model geschikt voor klantenservice of juridische samenvattingen.

Optimisatie bij inference

Tijdens gebruik (inference) kun je technieken toepassen zoals prompt-engineering, caching en model-compressie om snelheid en kosten te verbeteren. Voor MKB-projecten is dat cruciaal om binnen budget te blijven.

Waarom bedrijven LLMs inzetten en welke toepassingen werken in de praktijk?

Bedrijven gebruiken LLMs omdat ze taal-intensieve taken kunnen automatiseren en opschalen.

Praktische toepassingen zijn breed. Denk aan chatbots, automatische klantenservice, contentgeneratie en interne kennisbanken. LLMs kunnen ook helpen bij codegeneratie, vertalingen en sentimentanalyse.

Een tip: begin klein met één proces dat veel tijd kost of veel menselijke handelingen behoeft. Bijvoorbeeld het automatisch opstellen van productomschrijvingen.

Voorbeeld: chatbot voor klantenservice

Een chatbot kan 24/7 vragen afhandelen. Begin met beperkte use-cases zoals factuurvragen en orderstatus. Meet daarna doorlooptijd en klanttevredenheid. Als het goed gaat, breid je uit naar complexere thema’s.

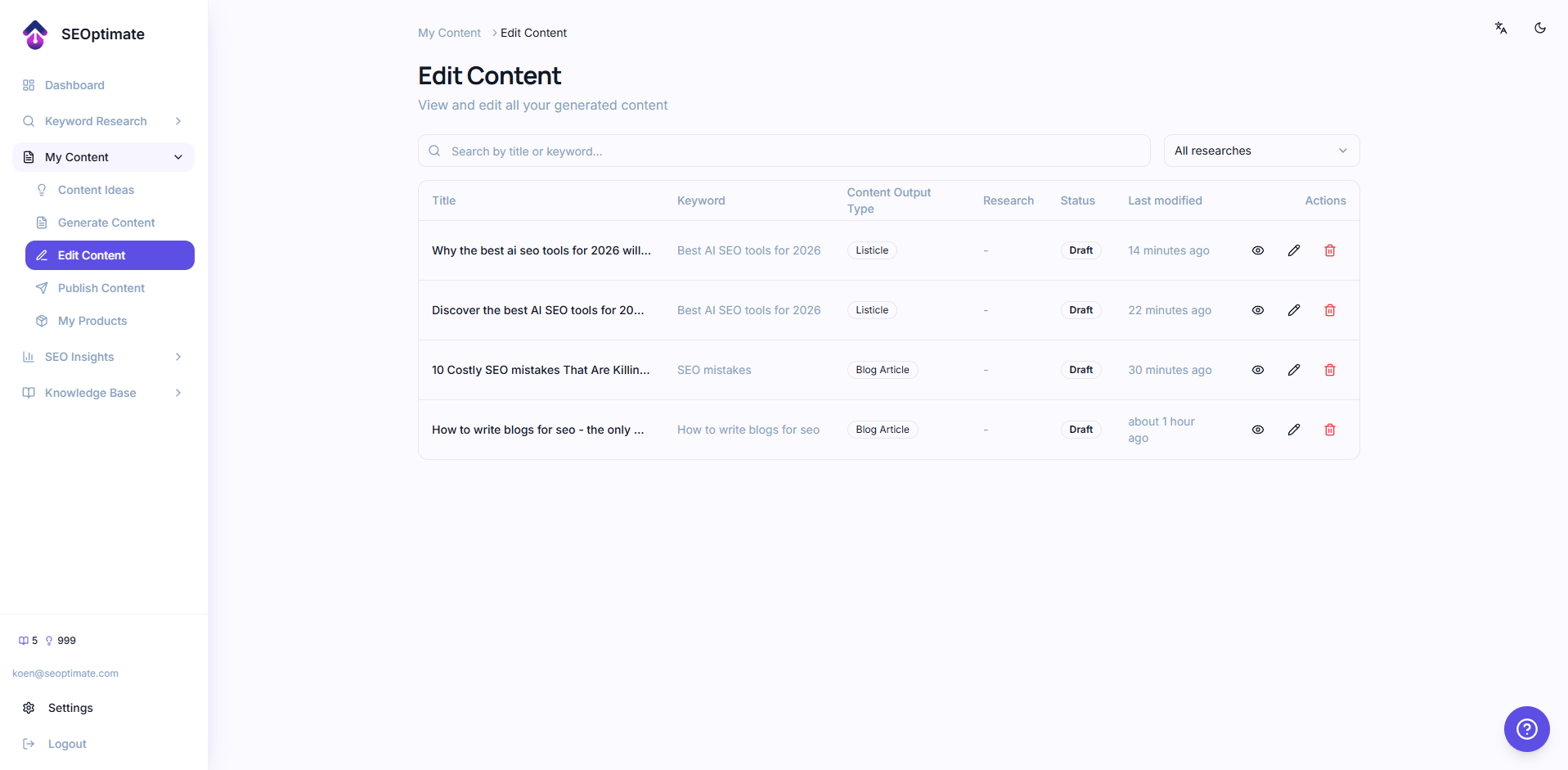

Voorbeeld: content en SEO

LLM’s helpen bij het schrijven van blogteksten, meta-beschrijvingen en advertenties. Let op kwaliteitscontrole: controleer feiten en tone of voice. Combineer automatisering met redactionele review om ranking en betrouwbaarheid te waarborgen. Menselijke controle blijft belangrijk en zorgt voor het menselijke aspect binnen een geschreven blog of pagina.

Interne kennisbanken en zoekoplossingen

Door documenten te indexeren en LLMs te koppelen kun je medewerkers sneller antwoorden laten vinden. Deze aanpak verhoogt productiviteit en verkleint de onboarding-tijd.

Praktische link & tip

Wil je voorbeelden van projecten die dit toepassen? Bekijk ons portfolio en zie hoe kleine stappen grote impact hadden. Ook onze inzichten over automatiseringen tonen vaak hoe LLMs binnen workflows passen.

Welke risico’s en beperkingen moet je kennen?

Kort en concreet: LLMs kunnen bias vertonen, hallucineren en privacyrisico’s hebben.

Bias ontstaat als trainingsdata scheef is. Hallucinaties zijn plausibele maar onjuiste antwoorden. Daarnaast speelt copyright en datalekgevaar een rol bij gevoelige data. Daarom raden we altijd een combinatie van technische en organisatorische maatregelen aan.

Technische mitigatie

- Data‑sanitatie: verwijder slechte of duplicaatdata voordat je fine-tuned.

- Input-filtering: voorkom dat vertrouwelijke velden in prompts belanden.

- Monitoring: log outputs en zet kwaliteitschecks in.

Proces- en governancemaatregelen

Definieer verantwoordelijkheden. Gebruik red-teaming en menselijke review voor kritische taken. Stel duidelijke acceptatiecriteria op voor outputs voordat ze in productie gaan.

Wettelijke en ethische aandachtspunten

Let op privacywetgeving zoals de AVG. Documenteer datasets en zorg voor transparante modeltoelichting richting gebruikers.

Hoe begin je concreet met LLMs in jouw organisatie?

Begin klein: kies één heldere use-case en werk iteratief naar een werkend resultaat.

Onderstaand stappenplan helpt je starten met een praktisch project, zonder meteen hoge kosten of ingewikkelde infrastructuur.

Stap-voor-stap aanpak

- Identificeer een pijnpunt: kies iets meetbaars (bijv. responstijd klantenservice).

- Definieer succescriteria: KPI’s zoals tijdsbesparing of CSAT-score.

- Proefconcept (POC): gebruik een bestaand model via API of open‑source instantie.

- Test & valideer: menselijke review en automatische checks op factualiteit.

- Schaal gefaseerd: optimaliseer prompts, voeg caching en monitoring toe.

- Governance: stel beleidsregels en verantwoordelijken aan.

Checklist om morgen te starten

- Heb je een duidelijk doel en KPI’s?

- Zijn data en bronnen beschikbaar en gewassen?

- Wie is eigenaar van het project intern?

- Welke fallback is er bij foutieve outputs?

- Hoe meet je succes en veiligheid?

Budget en resources

Verwacht kosten voor API-queries, hosting en data‑management. Begin met een klein testbudget. Bij Ever Evolve merken we dat een gerichte POC vaak al binnen enkele weken bruikbare inzichten oplevert.

Best practices en tips voor opschaling

Gebruik iteratie, monitoring en een mix van menselijke en automatische controles bij opschaling.

Voer A/B-tests uit op outputs. Meet nauwkeurig en pas bij. Zorg dat je logs en audits bewaart voor compliance en verbetering.

Opschalingsstrategie

- Optimaliseer prompts en tokengebruik om kosten te beheersen.

- Gebruik light‑weight modellen voor simpele taken en krachtige modellen voor complexe queries.

- Overweeg hybride architecturen: on-prem voor gevoelige data, cloud voor andere workloads.

Monitoring en feedbackloop

Zet metrics op zoals foutpercentages, latency en gebruikersfeedback. Gebruik deze data om modellen en prompts te verbeteren.

Onderhoud en data-refresh

Plan periodieke updates en retraining wanneer je model verouderd raakt. Documenteer wijzigingen en communiceer verwachtingen naar stakeholders.

Let op: LLMs zijn krachtig, maar vereisen beheer. Automatisering zonder governance leidt snel tot risico.

Ever Evolve is uw partner voor praktische, veilige en kostenefficiënte implementatie van LLM-oplossingen.

Large Language Models (LLM’s) maken het mogelijk om taalintensieve taken te automatiseren doordat ze patronen in grote hoeveelheden tekst leren.

Technisch werken ze met tokenisatie, embeddings en zelf‑attentie, en de combinatie van pre‑training en fine‑tuning maakt ze inzetbaar voor specifieke bedrijfsprocessen.

Voor MKB’ers zijn toepassingen zoals chatbots, contentgeneratie en interne kennisbanken vooral praktisch en schaalbaar wanneer je klein begint en iteratief verbetert.

Let daarbij op risico’s zoals bias, hallucinaties en privacy, en combineer technische mitigatie met governance en monitoring om betrouwbaarheid te waarborgen.

Een stapsgewijze aanpak met heldere KPI’s, een beperkte proefopzet en menselijke review minimaliseert kosten en vergroot de kans op succesvol gebruik.

Wil je weten hoe dit er concreet uitziet voor jouw organisatie, bekijk dan de genoemde producten en links in deze blog en ons portfolio voor voorbeelden en praktische stappen.

Kort: een LLM is een AI die op basis van context het volgende woord voorspelt om tekst te genereren of vragen te beantwoorden. Het gebruikt tokenisatie, embeddings en statistische patronen om samenhangende tekst te maken. Voorbeelden zijn GPT, BERT en open-weight modellen zoals Llama.

Kort: LLMs gebruiken tokenisatie, embeddings en zelf-attentie in een transformer-architectuur om context te wegen en tekst te voorspellen. Zelf-attentie bepaalt welke woorden belangrijk zijn voor elk token, waarna lagen deze informatie stapelen. Pre-training en fine-tuning maken het model geschikt voor algemene of specifieke taken.

Kort: effectieve use-cases zijn chatbots, automatische klantenservice, contentgeneratie en interne kennisbanken. Volgens Ever Evolve merken klanten dat een gefocuste POC op factuurvragen of productomschrijvingen snel waarde laat zien. Combineer met zoekindexing, prompt-engineering en redactionele review voor betere resultaten.

Kort: gebruik zowel technische als procesmaatregelen zoals data-sanitatie, input-filtering en monitoring om risico’s te verminderen. Zet menselijke review, red-teaming en duidelijke governance in en houd rekening met AVG en dataselectie. Volgens Ever Evolve voorkomt dit veel voorkomende problemen in productie.

Kort: begin klein met een meetbare use-case, duidelijke KPI’s en een beperkte POC via een API of open model. Test met menselijke validatie, optimaliseer prompts en bepaal een eigenaar en fallback-proces. Gebruik de checklist: doel, data, eigenaar, fallback en meetplan.

Kort: optimaliseer prompts, gebruik caching, en kies light-weight modellen voor eenvoudige taken om kosten te beheersen. Overweeg hybride architecturen (on-prem voor gevoelige data) en meet latency en foutpercentages. Volgens Ever Evolve betaalt dit zich terug in lagere API-kosten en betere responstijden.

Kort: kies prompt-engineering voor snelle tests en iteraties, en fine-tuning voor specifieke taken met gelabelde data en hogere nauwkeurigheid. Fine-tuning vereist data-sanitatie en governance; prompt-aanpak bespaart vaak kosten en tijd. In de praktijk combineren teams beide methoden voor optimale resultaten.